Per sfruttare davvero l'intelligenza artificiale, gli investitori sostenibili devono montare gli allarmi antifumo

L'intelligenza artificiale sta già rivoluzionando il modo in cui viviamo, lavoriamo e giochiamo ed è destinata a trasformare radicalmente il progresso globale in materia di sostenibilità. Non sorprende quindi che leader aziendali come il CEO di Google Sundar Pichai prevedano che il suo impatto sulla società umana sarà profondo come la scoperta del fuoco.

Ma come il fuoco, anche il potere di trasformazione dell'IA comporta dei rischi. La questione centrale per gli investitori è quindi come sfruttare il potenziale dell'IA senza rimanere scottati.

Il potere del capitale a lungo termine incontra il potere della tecnologia

Il modo in cui gli investitori istituzionali, in particolare, risponderanno a questa sfida potrebbe plasmare il futuro di tutti noi.

Gli investitori istituzionali sono attori su larga scala che gestiscono enormi pool di capitali, tra cui piani pensionistici e assicurativi. A differenza di altri partecipanti ai mercati globali, tendono ad avere una visione a lungo termine, investendo in modo da produrre rendimenti sostenibili tra 25 anni o più. Ciò rende la sostenibilità una considerazione fondamentale per gli investitori istituzionali, come dimostra il fatto che oltre la metà del patrimonio istituzionale mondiale è oggi gestito dai firmatari dei Principi per l'Investimento Responsabile delle NazioniUnite1.

Tutto ciò fa sì che gli investitori istituzionali siano fondamentali per definire il modo in cui l'IA verrà integrata nei settori industriali nei prossimi anni. Attualmente, essi guardano all'IA per guidare la sostenibilità in due modi chiave:

1) Investire nella rivoluzione della sostenibilità dell'IA: Essi vedono come l'investimento diretto o indiretto in aziende che forniscono o utilizzano l'IA possa contribuire a catalizzare la transizione verso un'economia sostenibile e a basse emissioni di carbonio. Questo potrebbe aiutarli sia a gestire i rischi a lungo termine legati al cambiamento climatico e alla perdita di natura, sia a cogliere nuove opportunità per investire nei vincitori della sostenibilità di domani.2

2) Potenziamento delle decisioni di investimento con l'IA: gli investitori guardano all'IA come a uno strumento per migliorare la velocità, la qualità, la profondità e la portata dei loro processi decisionali di investimento.

Investire nella rivoluzione della sostenibilità dell'IA

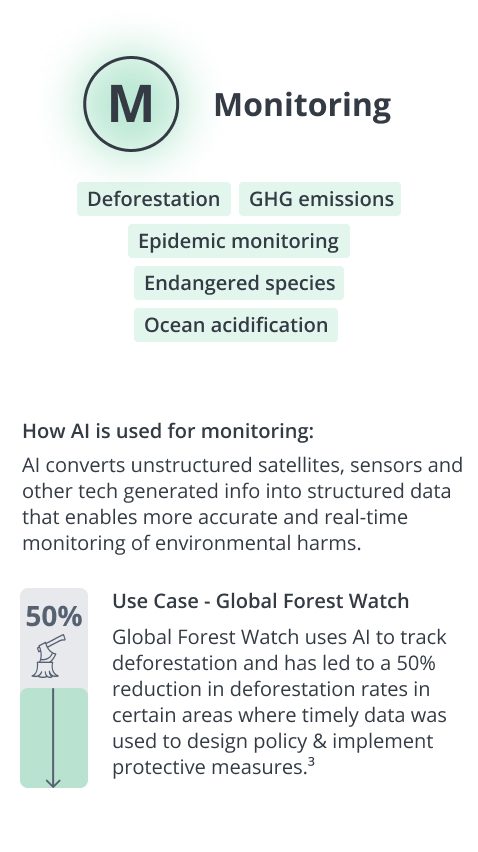

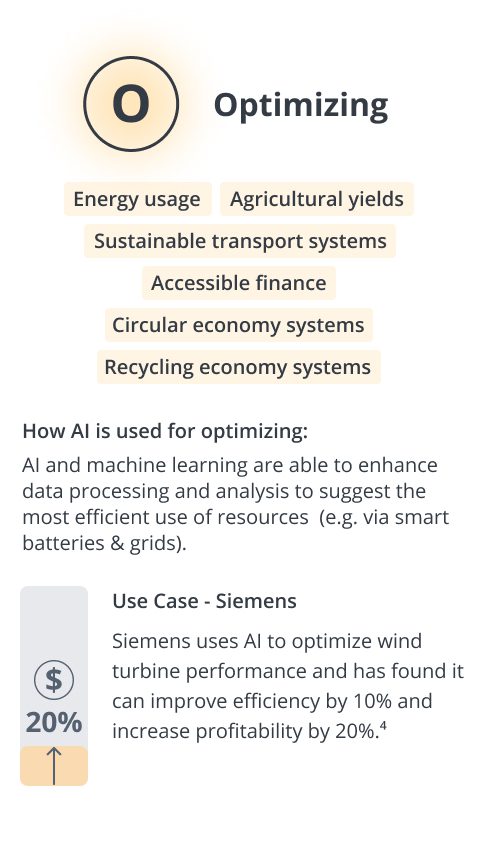

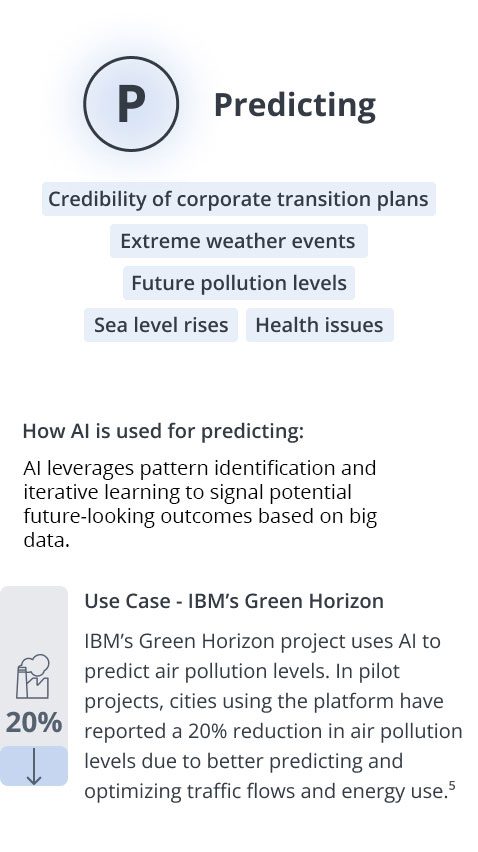

L'IA ha il potenziale per rivoluzionare settori diversi come l'energia, l'agricoltura, l'assistenza sanitaria e la conservazione degli oceani, aiutandoci a monitorare, ottimizzare e prevedere (MOP) i progressi verso gli obiettivi di sostenibilità globale, come illustrato nella Figura 1. Mi piace pensare che gli investitori utilizzino l'IA per "migliorare" le sfide della sostenibilità. Mi piace pensare che gli investitori utilizzino l'IA per "migliorare" le sfide della sostenibilità.

Incanalando il capitale nelle innovazioni guidate dall'IA, gli investitori non solo accelerano i progressi verso gli obiettivi globali chiave, come l'Accordo di Parigi, gli SDG e l'obiettivo 30×30 del Quadro globale per la biodiversità, ma sbloccano anche potenziali opportunità per ottenere migliori rendimenti corretti per il rischio. In questo duplice ruolo, essi sostengono un'economia più sostenibile e a basse emissioni di carbonio, migliorando al contempo la propria resilienza in un mercato in rapida evoluzione.

Figura 1: Come l'IA può essere usata per migliorare la sostenibilità

Potenziare le decisioni di investimento con l'IA: dai dati all'azione

Il secondo approccio alla sostenibilità che gli investitori istituzionali stanno adottando con l'IA è quello di migliorare la velocità, la qualità, la profondità e la portata dei loro processi decisionali di investimento.

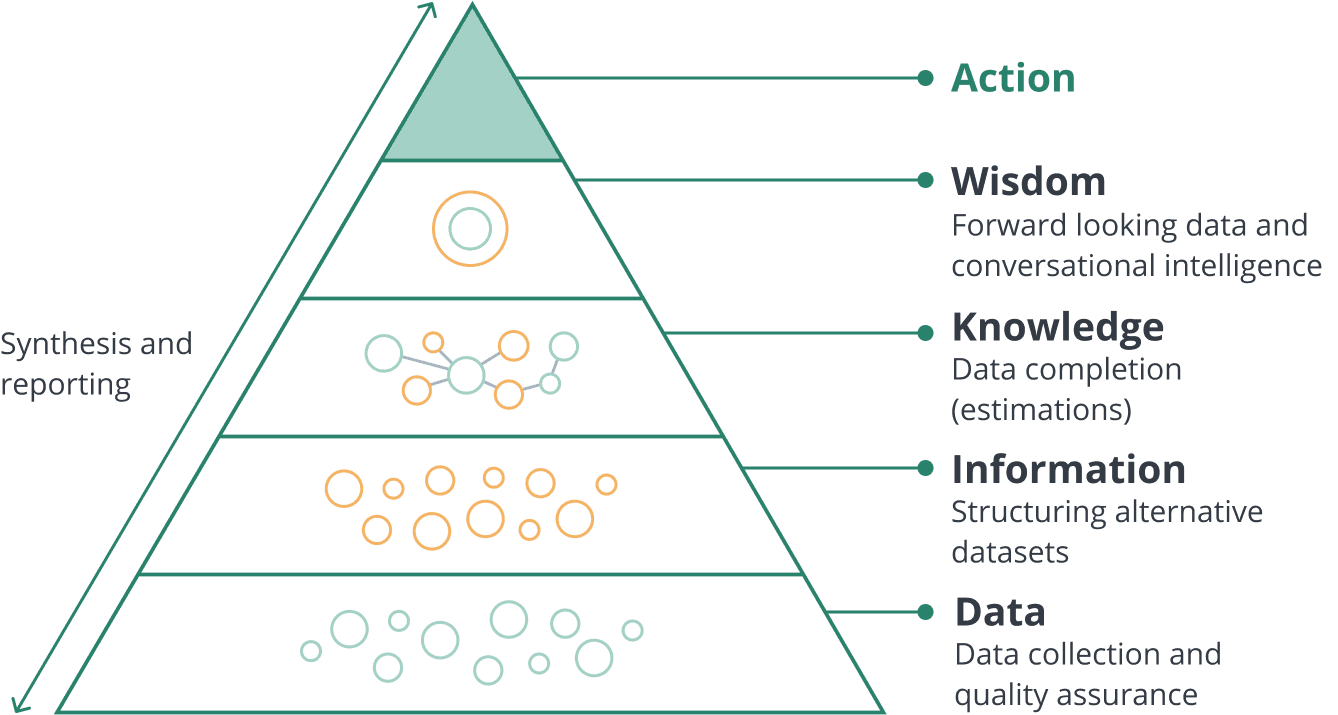

Gli investitori istituzionali diversificano i loro portafogli tra migliaia di società e titoli globali, creando un ecosistema di milioni di dati. Questo comporta sfide persistenti sulla qualità e la copertura di tali dati e informazioni e su come trasformarli in conoscenza, saggezza e azione di valore. L'IA ha il potenziale per rimodellare radicalmente tutte le parti della piramide della conoscenza che sta alla base di ogni decisione di investimento (cfr. Figura 2).

Per la raccolta dei dati, l'intelligenza artificiale e l'apprendimento automatico sono preziosi per acquisire informazioni da fonti e formati diversi (come testo, tabelle e grafici) e migliorare l'affidabilità dei dati. Il controllo della qualità non è una questione marginale. La nostra ricerca ha rilevato che su tre fornitori di dati che offrivano ai clienti gli stessi punti di emissione segnalati, i dati erano diversi il 13% delle volte e mostravano una discrepanza di oltre il 20%.

L'intelligenza artificiale può anche aiutare a colmare le lacune di dati quando non sono disponibili i dati autodichiarati dalle aziende, facendo stime più accurate rispetto alle medie del settore utilizzando set di informazioni comparabili e alternativi, come notizie o dati geospaziali. Ad esempio, gli strumenti di IA possono ora sovrapporre le dichiarazioni sui diritti umani delle aziende con le informazioni tratte da notizie globali e da fonti indipendenti per vedere se corrispondono.

Per trasformare i dati in informazioni utili, le soluzioni di assistenza AI consentono oggi agli investitori istituzionali di dialogare in modo intelligente con i loro portafogli sui temi della sostenibilità. Possono chiedere informazioni su fonti di dati, metodologie, performance e raccomandazioni per migliorare i punteggi. Inoltre, l'IA viene utilizzata per fornire approfondimenti lungimiranti. Ad esempio, abbiamo utilizzato l'intelligenza artificiale per analizzare i piani di decarbonizzazione dei 400 maggiori emettitori mondiali, scoprendo che solo il 40% ha piani di transizione credibili.

Infine, l'IA sta già aiutando gli investitori a redigere relazioni ai loro numerosi stakeholder in diversi formati, stili e lingue. Forse l'aspetto più importante per gli investitori di oggi è che l'IA può offrire modi per ottimizzare la rendicontazione di conformità, riducendo l'onere di rendicontazione e consentendo agli investitori responsabili di concentrarsi sulle decisioni di investimento.

Figura 2: La piramide della conoscenza

Installazione degli allarmi antincendio E, S e G

I potenziali vantaggi dell'IA sono enormi, ma non sono esenti da rischi. Proprio come gli allarmi antifumo proteggono le nostre case, l'economia moderna ha bisogno di installare sistemi di allerta precoce e guardrail che ci consentano di procedere in sicurezza con l'uso dell'IA. Ciò significa ridurre al minimo il potenziale uso improprio dell'IA nelle tre aree chiave del rischio ambientale, sociale e di governance. Come spesso accade per gli investitori, iniziamo dalla governance.

Gestione dei rischi di governance dell'IA

I fattori da considerare nella governance dell'IA sono molti, ma un modo semplicistico per coglierli è quello di utilizzare i seguenti punti principali:

- Responsabilità e supervisione: Assegnare una chiara responsabilità per la proprietà e la gestione dell'IA in cui si investe o che si utilizza. Non si dovrebbe mai arrivare a dire "è colpa dell'IA!".

- Disinformazione e allucinazioni: Assicurarsi che il modello di IA abbia le opportune protezioni per evitare risultati fuorvianti o vere e proprie falsificazioni.

- Privacy e sicurezza dei dati: Garantire che l'IA o l'utente che interagisce con essa non utilizzi dati a cui non ha accesso autorizzato.

- Equità e non discriminazione: Garantire che il modello o l'algoritmo di IA non sia addestrato su dati parziali che possono portare a un trattamento iniquo o all'esclusione di determinati individui o gruppi.

- Trasparenza e spiegabilità: Garantire che il funzionamento del modello di IA sia divulgato e spiegato in misura tale da renderlo affidabile e comprensibile.

Anche nelle fasi iniziali dell'IA è emersa una cattiva governance, come nel caso di Clearview AI. L'azienda statunitense di riconoscimento facciale ha dovuto affrontare multe da parte delle autorità di regolamentazione del Regno Unito, dei Paesi Bassi e di altri Paesi per aver raccolto miliardi di immagini dai social media senza il consenso degli utenti.

Per affrontare questi rischi, gli investitori devono applicare principi di governance e linee guida per la gestione dell'IA. I principi chiave che guidano il settore sono i Principi dell'OCSE sull'IA. Aggiornati nel maggio 2024 per tenere conto dei rischi emergenti introdotti da strumenti di IA generativa come ChatGPT e Google Bard, sono il principale punto di riferimento per chiunque voglia affrontare l'IA in modo responsabile.

Inoltre, vi è un numero crescente di attori che offrono linee guida per la gestione del rischio, come The Partnership on AI, AI4People, Future of Life Institute, The Green Digital Finance Alliance (GDFA) e The Responsible AI Institute (RAI).

Le linee guida specifiche per gli investitori includono il Responsible AI Playbook for Investors del WEF, Ethics and Artificial Intelligence in Investment Management del CFA Institute e il Guiding Framework for Responsible AI Integration Into ESG Paradigms del RAI, che affronta in particolare gli investimenti sostenibili.

Questi principi e linee guida mirano a evitare che l'IA amplifichi problemi come i pregiudizi e la disinformazione, o consenta danni come la sorveglianza di massa e le violazioni dei diritti umani. Essi pongono l'accento sulla responsabilità, richiedendo trasparenza su chi impiega l'IA e su chi è responsabile dei suoi risultati.

Stiamo anche assistendo all'emergere di discussioni su quali siano le migliori pratiche per la politica sull'IA, soprattutto in seguito alla ratifica della legge europea sull'IA. Prevediamo che un numero maggiore di regolamenti mirerà a governare l'IA e stiamo vedendo emergere idee politiche forti che si concentrano sul bilanciamento dell'innovazione con la gestione del rischio, sulla creazione di sandbox per i test, sulla personalizzazione delle regole per settore e sulla garanzia di interoperabilità transfrontaliera allineata ai principi dell'IA dell'OCSE.

Gestione dei rischi ambientali dell'IA

L'IA ha il potenziale per accelerare i progressi verso gli obiettivi climatici e naturalistici globali. Tuttavia, l'IA pone anche sfide ambientali che devono essere gestite.

Il più importante è l'uso dell'elettricità e dell'acqua.

I data center, essenziali per l'infrastruttura dell'IA, rappresentano il 2-4% del consumo di elettricità nelle principali economie come gli Stati Uniti, la Cina e l'UE, una cifra destinata a crescere con l'aumento della domanda di IA. Allo stesso modo, i sistemi di IA richiedono una notevole quantità di acqua: secondo le stime, entro il 2027 potrebbero essere necessari fino a 6,6 miliardi di m³ di prelievo idrico a livello globale, più della metà dell'uso annuale di acqua del Regno Unito. A causa dei loro investimenti nell'IA, aziende tecnologiche come Microsoft e Google hanno visto crescere i loro gas serra di circa il 30-50%, nonostante i loro impegni a zero emissioni.

Gli investitori svolgono un ruolo fondamentale nella gestione di questi rischi. Il consumo di elettricità dell'IA dovrebbe basarsi sempre più sulle energie rinnovabili, motivo per cui le aziende tecnologiche stanno investendo molto nell'energia priva di carbonio. Ne sono un esempio la partnership di Microsoft con Brookfield Renewable e i recenti investimenti di Amazon e Google in piccoli reattori nucleari per l'energia pulita.

Anche l'uso dell'acqua dovrebbe essere ridotto al minimo attraverso sistemi a ciclo chiuso e pratiche sostenibili, assicurando che non venga sottratta ai bisogni umani essenziali e che le acque reflue siano gestite in modo sicuro e riutilizzate, ad esempio, nei sistemi di riscaldamento locali.

Per ridurre l'impatto ambientale, i modelli di IA dovrebbero essere efficienti dal punto di vista delle risorse e in linea con i casi d'uso specifici: non sempre i modelli di IA generativi sono necessari quando sono sufficienti modelli più semplici, che richiedono meno risorse. In particolare, l'IA sta contribuendo a mitigare la propria impronta ambientale. DeepMind AI di Google, ad esempio, ottimizza l'uso dell'energia nei suoi centri dati e ha ottenuto una riduzione del 40% nel consumo di energia per il raffreddamento.6

Infine, una gestione ambientale responsabile dell'IA richiede un approvvigionamento sostenibile dei materiali per i centri dati e l'hardware. I metalli delle terre rare, come il litio e il cobalto, sono fondamentali per l'IA, ma comportano rischi ambientali e umani se estratti in modo irresponsabile. Inoltre, l'hardware dell'IA utilizza spesso sostanze chimiche tossiche e metalli pesanti come piombo, cadmio e mercurio. Senza un corretto smaltimento, questi possono infiltrarsi nel suolo e nell'acqua.

Gestione dei rischi sociali dell'IA

I potenziali benefici sociali dell'IA - che vanno da nuovi trattamenti sanitari a un migliore accesso all'istruzione - sono significativi, anche se spesso meno discussi rispetto agli impatti ambientali.

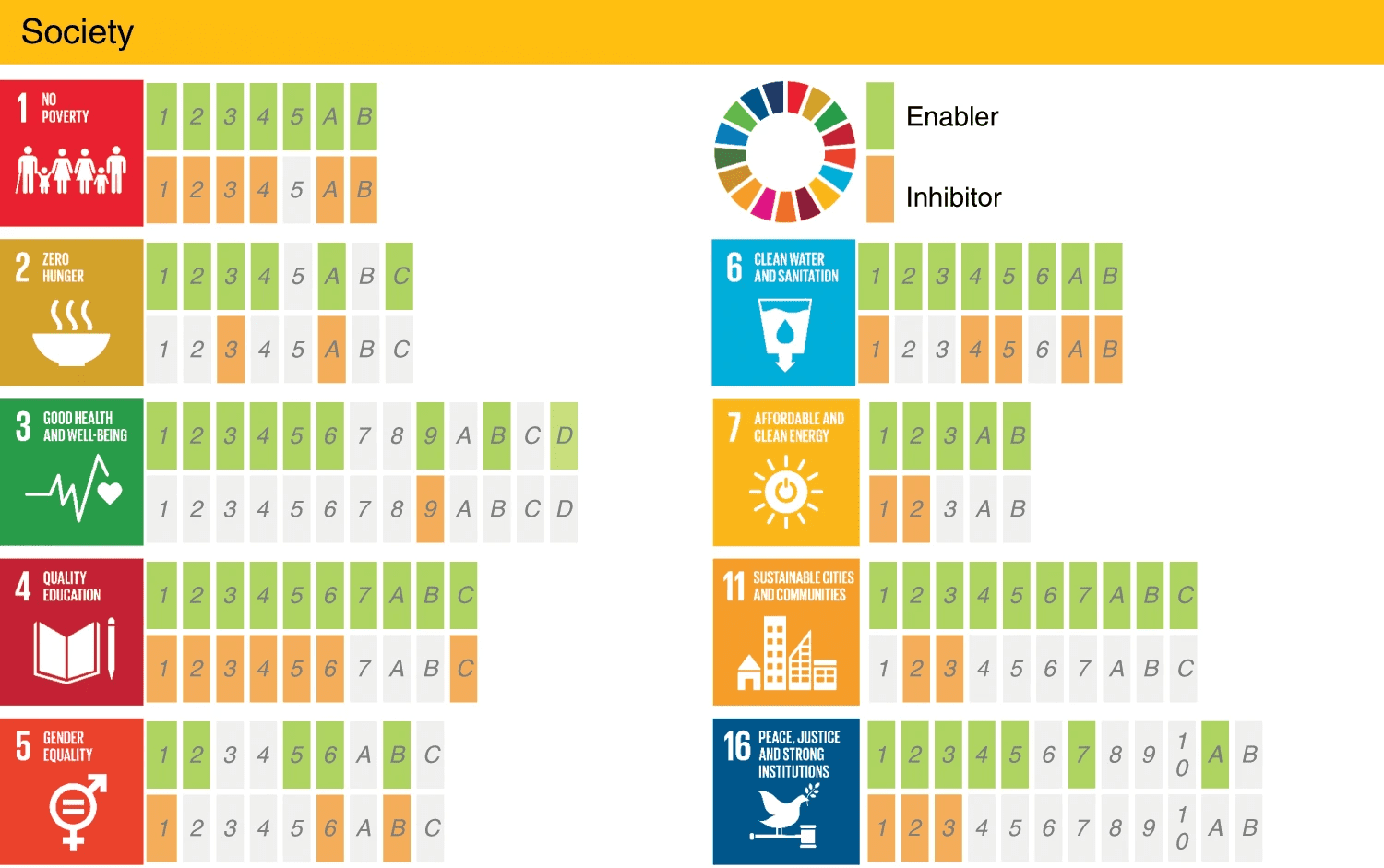

Uno studio pubblicato su Nature Journal nel 2020 ha rilevato che l'IA potrebbe contribuire positivamente a 134 dei 169 (79%) Obiettivi di Sviluppo Sostenibile delle Nazioni Unite (Figura 3)7 .

Tuttavia, ha anche avvertito che i rischi sociali legati all'IA potrebbero ostacolare il progresso di 59 dei 169 (35%) SDG se non viene gestita con saggezza.8 Alcuni di questi problemi si sovrappongono a quelli di governance sopra descritti. Ad esempio, c'è il rischio che l'IA possa esacerbare pregiudizi o trattamenti iniqui nei processi di assunzione.

Figura 3: Impatti positivi e negativi dell'IA sul raggiungimento di un campione di SDGs

Fonte: Nature Journal

Nota: campione basato solo sui 9 SDG "legati alla società".

Una delle principali preoccupazioni sociali discusse in relazione all'IA è il suo impatto sul mercato del lavoro.

Se da un lato l'IA aumenterà la produttività e creerà nuovi ruoli, dall'altro McKinsey prevede che entro il 2030 le attività che rappresentano fino al 30% delle ore lavorate attualmente nell'economia statunitense potrebbero essere automatizzate grazie all'accelerazione dell'uso dell'IA generativa.

Come per il cambiamento climatico, questo cambiamento richiederà una "giusta transizione", con governi e aziende che investono nella formazione per aiutare i lavoratori ad adattarsi.

Anche se non è tutta la storia, c'è qualcosa di vero nella tanto citata affermazione che "l'IA non ti toglierà il lavoro, ma lo farà qualcuno che sa come usare l'IA".

È incoraggiante notare che l'etica e la governance dell'IA sono già state integrate nei programmi di studio delle università e degli istituti tecnici pertinenti. È necessario che i governi, le ONG e le istituzioni educative intensifichino le campagne di sensibilizzazione per dotare i cittadini delle conoscenze necessarie a gestire i rischi dell'IA.

Una scheda informativa sull'intelligenza artificiale per gli investitori

Gli investitori istituzionali stanno già monitorando attentamente i rischi ESG dell'IA. Un recente sondaggio di Capital Group su oltre 1.000 investitori istituzionali mostra che questi rischi sono considerati rilevanti in diverse regioni e argomenti. La protezione dei dati e la privacy emergono come le principali preoccupazioni, mentre altre questioni di governance, ambientali e sociali sono considerate rilevanti da almeno la metà degli intervistati in una o più regioni a livello globale.9

Per aiutare gli investitori ad affrontare queste sfide, la Figura 4 delinea i rischi principali e le azioni di mitigazione. Questi possono essere applicati quando si impiega l'IA o utilizzati come criteri di valutazione degli investimenti in aziende che sviluppano o implementano l'IA.

Figura 4: Principali rischi ESG dell'IA per gli investitori sostenibili e le strategie di gestione

La governance

I rischi

- Ruoli e responsabilità non chiari

- Allucinazioni da parte di modelli GenAI

- Violazione della privacy e della sicurezza dei dati

- Pregiudizio

- Mancanza di trasparenza e spiegabilità

Strategie di mitigazione

- Assegnare una chiara responsabilità e supervisione (a livello operativo e di consiglio di amministrazione).

- Applicare modelli di IA giudiziosi, specifici per i casi d'uso e con le opportune protezioni (ad esempio, gli esseri umani sono coinvolti nel ciclo, se necessario).

- Garantire la privacy, l'anonimizzazione e la sicurezza dei dati, ottenendo certificazioni adeguate e riconosciute e applicando la legislazione esistente e futura (compreso l'AI act dell'UE).

- Testare continuamente i modelli di IA per garantire che rimangano resistenti alle minacce informatiche e che funzionino in modo accurato.

- Selezionate i vostri set di dati in modo appropriato ed equo, in modo che rappresentino realmente la popolazione di utenti che servite.

- Implementare le protezioni contro le allucinazioni, ad esempio fornendo riferimenti.

- Offrire trasparenza sulle fonti dei dati, sulla progettazione del modello, sui fattori utilizzati e sull'approccio di apprendimento.

- Verificate la spiegabilità, che è fondamentale e richiesta per legge in diverse giurisdizioni.

Ambiente

I rischi

- L'elevato utilizzo di energia elettrica determina le emissioni di CO2

- Elevato consumo di acqua

- Rifiuti chimici derivanti dallo smaltimento di vecchio hardware

- Impatto minerario dovuto al rame e ad altre materie prime specifiche richieste per i data center

Strategie di mitigazione

- Selezionare e guidare l'ulteriore crescita delle energie rinnovabili.

- Gestire le risorse idriche per garantire un uso circolare (ad esempio, per il riscaldamento delle abitazioni), limitare i danni ad altri consumi idrici (umani o agricoli) e limitare i danni alla biodiversità (ad esempio, evitare lo smaltimento di acqua calda negli habitat).

- Selezionare modelli progettati per casi d'uso specifici, limitando gli sprechi e ottimizzando l'uso dell'energia.

- Scegliere hardware e chip che favoriscano l'efficienza energetica.

- Garantire un'adeguata tracciabilità della catena di approvvigionamento per assicurare che i prodotti provengano da miniere responsabili.

- Supervisionare il corretto smaltimento dei rifiuti tossici.

Sociale

I rischi

- Dislocazione del lavoro

- Rischio di esacerbare pregiudizi e discriminazioni

- Violazione della privacy e della sicurezza dei dati

Strategie di mitigazione

- Impegnarsi con i governi e gli enti normativi per garantire la progettazione di politiche per una giusta transizione.

- Assicurarsi che i modelli siano controllati e rivisti regolarmente per evitare pregiudizi, soprattutto in materia di reclutamento e salute.

- Offrire programmi di formazione e istruzione per il personale, la catena di fornitura e gli utenti finali.

- Investite in programmi di riqualificazione per aiutare i dipendenti a passare a ruoli complementari all'IA, come la supervisione e la strategia.

- Promuovere la collaborazione tra uomo e IA, concentrandosi sull'utilizzo dell'IA come strumento per aumentare il processo decisionale umano piuttosto che sostituirlo completamente.

- Adottare le azioni di governance sopra descritte.

Il ritardo non è un'opzione

Cosa significa tutto questo per gli investitori sostenibili?

L'intelligenza artificiale può migliorare le decisioni di investimento lungo tutto il ciclo del portafoglio, dalla raccolta dei dati alla rendicontazione, e trasformare i risultati finanziari e di sostenibilità della loro attività di investimento. Ma non è un pranzo gratis. Gli investitori devono essere sicuri dell'uso e dell'investimento nell'IA, progettando il proprio approccio alla gestione dei rischi.

Il punto di partenza è stabilire la responsabilità e la governance per supervisionare la strategia e l'implementazione dell'IA, utilizzando principi come i Principi dell'IA dell'OCSE, allineandosi ai nuovi quadri e regolamenti e bilanciando la gestione del rischio con l'innovazione.

Devono inoltre affrontare i rischi ambientali e sociali dell'IA, ad esempio utilizzando modelli e chip ad alta efficienza energetica, scegliendo un'IA che si affida a centri dati alimentati da fonti rinnovabili e investendo nella formazione sull'IA per il personale tecnico e non, sostenendo al contempo una "transizione giusta" dell'IA.

Il ritardo non è un'opzione. La tecnologia si sta sviluppando rapidamente e gli investitori istituzionali che non muovono subito i primi passi rischiano di rimanere indietro.

Riferimenti

- Atkin, David. "Incontrare gli investitori dove sono: PRI lancia una nuova strategia". Principi per l'Investimento Responsabile. Accesso al 4 novembre 2024. https://www.unpri.org/pri-blog/meeting-investors-where-theyre-at-pri-launches-new-strategy/12636.article.

- Climate Change AI è una buona risorsa per esplorare il potenziale dell'IA, in particolare dell'apprendimento automatico, nell'affrontare i cambiamenti climatici.

- Istituto mondiale delle risorse. "Il Global Forest Watch aiuta i popoli indigeni a ridurre la deforestazione". Accesso al 4 novembre 2024. https://www.wri.org/outcomes/global-forest-watch-helps-indigenous-peoples-reduce-deforestation?t.

- BloombergNEF. "Siemens dice che l'intelligenza artificiale può aumentare i profitti delle centrali elettriche del 20%: DOMANDE E RISPOSTE". Accesso al 4 novembre 2024. https://about.bnef.com/blog/siemens-says-ai-can-boost-power-plant-profit-20-qa/?t.

- Newswire. "IBM espande l'iniziativa Green Horizons a livello globale per affrontare le pressanti sfide ambientali e dell'inquinamento". 9 dicembre 2015. Accesso al 4 novembre 2024. https://www.newswire.ca/news-releases/ibm-expands-green-horizons-initiative-globally-to-address-pressing-environmental-and-pollution-challenges-561197251.html?t.

- DeepMind. "L'intelligenza artificiale di DeepMind riduce del 40% la bolletta del raffreddamento del centro dati di Google". 20 luglio 2016. Accesso al 4 novembre 2024. https://deepmind.google/discover/blog/deepmind-ai-reduces-google-data-centre-cooling-bill-by-40/?t.

- Rolnick, David, Priya L. Donti, Lynn H. Kaack, Kelly Kochanski, Alexandre Lacoste, Kris Sankaran, Andrew Slavin Ross, et al. "Affrontare il cambiamento climatico con l'apprendimento automatico". Nature Communications 11, n. 1 (2020): Article 132. https://www.nature.com/articles/s41467-019-14108-y.

- Ibidem.

- Jessica Ground. "L'ascesa dell'IA e dell'ESG". Capital Group, consultato l'8 novembre 2024. https://www.capitalgroup.com/institutions/fr/en/insights/articles/the-rise-of-ai-and-esg.html.